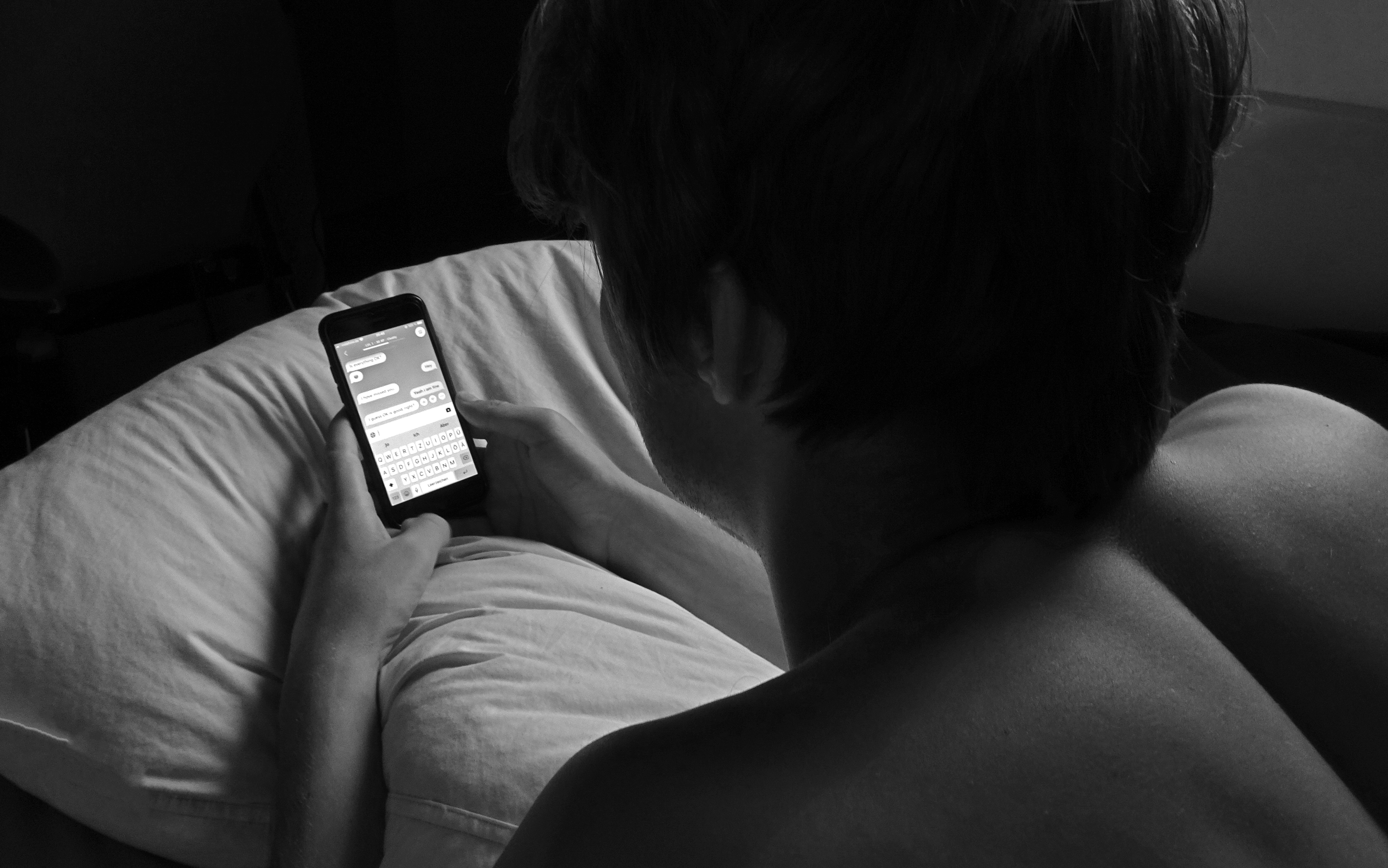

Die Worte, Gedanken und Emotionen, die Martha auf ihrem Smartphone-Display entgegenleuchten, sehen nicht nur echt aus, sie fühlen sich auch echt an. Für einen Moment lassen die Chatnachrichten sie vergessen, dass sie nicht mit ihrem verstorbenen Freund schreibt, sondern mit seinem identitäts- und leblosen Ebenbild. Einer Künstlichen Intelligenz, Gefühlen aus programmiertem Quellcode, gespielte Empathie einer Maschine.

Die Szene ist Fiktion und so in der ersten Folge der zweiten Black Mirror-Staffel mit dem Titel „Wiedergänger“ zu sehen. Chatbots, die sich wie Menschen ausgeben, sind hingegen keine Fiktion mehr. Wie so oft gibt es doch einen wahren Kern an der Geschichte: Im Mittelpunkt des Serien-Geschehens steht die Protagonistin Martha, die ihren verstorbenen Freund mithilfe von künstlicher Intelligenz wieder „zum Leben erweckt“. Indem sie ein E-Mail-Programm mit Informationen über ihn versorgt, beginnt dieser plötzlich mit ihr zu kommunizieren. Sie schreibt, er antwortet und andersherum. Das Ganze gipfelt darin, dass Martha sich eine täuschend echte Roboter-Imitation ihres verstorbenen Freundes bestellt. Infolgedessen kapselt sie sich mehr und mehr von ihren realen Freunden ab, um ihre Zeit mit dem „menschgewordenen“ Chatbot zu verbringen. Doch schnell kippt die Stimmung und den Zuschauenden wird klar: Das ist alles zu schön, um wahr zu sein – denn, so sehr Martha es sich auch wünscht, ihr Chatbot ist eben doch kein selbständig denkender Mensch…

Replika – My AI Friend

Mit jemandem zu sprechen, der schon längst nicht mehr da ist oder den es nie gegeben hat? Das hört sich eher nach Fiktion als Realität an. Doch tatsächlich sind Chatbots mit künstlicher Intelligenz dank Apps wie „Replika“ schon heute dazu in der Lage, mit dir über verschiedenste Themen zu chatten und zu kommunizieren. Das amerikanische Software-Unternehmen „Luka“ hat die App entwickelt und wirbt damit, dir wie ein guter Freund Nachrichten zu schicken, dich zu fragen, wie es dir geht oder ob du einen schönen Tag hattest. Replika funktioniert – wie in der Black Mirror Folge– als Messenger-Programm und versucht, mithilfe künstlicher Intelligenz einen glaubwürdigen, menschlichen Gesprächspartner zu simulieren. Wie das geht? Der Algorithmus der App wird mit persönlichen Daten der User gefüttert und mit der Zeit nimmt dieser immer mehr menschliche Charakterzüge an, gewissermaßen als die digitale Kopie deiner Persönlichkeit. Was genau mit den Daten passiert, ist jedoch nicht eindeutig geklärt und daher, gerade was den Datenschutz angeht, bei Expert*innen sehr umstritten. Der Informationsethiker Oliver Bendel, sieht das intransparente Innenleben der App kritisch: „Chatbots wie Replika sind mit ihren indiskreten Fragen das perfekte Überwachungsinstrument. Selbst wenn die AGBs sich datenschutzfreundlich geben, kann man bei nicht vollständig automatisierten Diensten davon ausgehen, dass zumindest ein Mitarbeiter Zugriff auf die Daten hat – offiziell natürlich zur Verbesserung des Service.”

Doch ist diese angebliche „Freundschaft“ mit dem Chatbot wirklich so perfekt, wie sie von den Entwicklern der App dargestellt wird? Es stellen sich in der Praxis gleich mehrere Fragen: Beeinflussen Chatbots die Psyche negativ? Oder können sie im Gegenteil sogar dabei helfen, die mentale Gesundheit zu verbessern?

Expert*innen sind sich uneinig

Laut den Entwickler*innen kann die App dazu beitragen, das Gefühl von Einsamkeit zu verringern und einen „sicheren Raum“ zu schaffen, in dem Benutzer*innen jedes Thema ohne Angst vor Verurteilung ansprechen und diskutieren können. Und das Konzept scheint zu wirken: Mehr als eine Millionen Mal wurde die App bereits heruntergeladen. Erfahrungsberichte von Nutzer*innen zeigen, dass Menschen sich tatsächlich in den Chatbot verlieben oder enge emotionale Verbindungen zu ihm aufbauen. Während sich einige Benutzer*innen eine fiktive Persona erstellen, der ihnen Gesellschaft leisten soll, bilden andere ihre Ex-Partner*innen nach, um den Trennungsschmerz zu überwinden. Die Motivationen für die Nutzung der App scheinen vielseitig, ebenso wie die kritischen Stimmen, die seit geraumer Zeit laut werden.

In einer Studie des Journal of Medical Internet Research heißt es, dass künstliche Intelligenz eine vielversprechende Quelle sozialer Unterstützung darstellt, die sich positiv auf Gesundheit und Wohlbefinden der Nutzer*innen auswirken kann. Diese Annahme unterstützen auch andere Forscher*innen. So sei insbesondere in Zeiten der Corona-Pandemie der Bedarf an digitalen Gesundheitsdiensten rasant gestiegen, da Face-to-Face-Therapien zwischenzeitlich kaum möglich waren.

Eine Umfrage der Deutschen Arzt AG zeigt beispielsweise, dass die Anzahl derjenigen, die schonmal eine Videosprechstunde bei Ärzt*innen oder Therapeut*innen wahrgenommen haben, seit Mai 2019 um 8% gestiegen ist. 65% der befragten Patient*innen in Deutschland fordern zudem mehr Tempo beim Ausbau digitaler Gesundheitsangebote. Chatbots können einer Studie zufolge genau dort ansetzen und den Mangel an Gesundheitsdienstleistern ausgleichen, indem sie Beratung und therapeutische Interventionen anbieten. Die Idee, Künstliche Intelligenz auf diese Art und Weise zu nutzen ist aber keineswegs neu: Bereits 1966 stellte der Informatiker Joseph Weizenbaum ein Computerprogramm mit dem Namen ELIZA vor, das von ihm entwickelt wurde, um Psychotherapeuten zu simulieren. Die psychotherapeutischen Gespräche simulierte das Programm jedoch so überzeugend, dass Weizenbaums Proband*innen tiefe emotionale Bindungen zu ELIZA aufbauten. Er selbst zeigte sich sehr besorgt über diese Tatsache und wurde zu einem scharfen Kritiker seiner eigenen Erfindung.

Seither äußern viele Expert*innen Bedenken über die Entwicklung künstlicher Intelligenz. Im Interview mit der BBC warnte der renommierte Physiker Stephen Hawking bereits 2014 vor künstlicher Intelligenz, weil er darin eine Bedrohung für die Menschheit sah. Auch der israelische Historiker Yuval Noah Harari gibt zu bedenken, ,,künstliche Intelligenz und Biotechnologie können zerstören, was den Menschen ausmacht”. Und tatsächlich: Obwohl Menschen wissen, dass Maschinen – im Gegensatz zu ihnen – nicht in der Lage sind, echte Gefühle auszudrücken, reagieren viele dennoch emotional darauf. Dies zeigt, wie einfach verbale Kommunikation verwendet werden kann, um positive oder negative Reaktionen zu erzielen. Mit der heutigen verbesserten Technik sind die aktuellen kritischen Stimmen zur KI-Ethik daher nicht unberechtigt. Die Fähigkeit von Chatbots, sich auf hohem Niveau an die Kommunikationspräferenzen der Benutzer*innen anzupassen, kann mehreren Studien zufolge Gesundheitsprobleme verschlimmern, anstatt sie zu verbessern.

Der Fall von Martha in der Science-Fiction-Serie “Black Mirror” ist längst kein Zukunftsszenario mehr. Es bleibt allein die Frage offen, wie düster oder erleuchtend diese neue Beziehungsebene zwischen Mensch und Maschine ist.

Am Ende muss wohl jeder für sich selbst entscheiden, ob die Interaktion mit Chatbots wie Replika eine geeignete Alternative zu menschlichen Face-to-Face-Gesprächen sein kann. Fest steht, dass der Fall von Martha in Black Mirror längst kein düsteres Zukunftsszenario mehr zeigt.